Искусственный интеллект как оружие пропаганды.

Садырбаев Темирлан

Аннотация. В статье рассматривается использование искусственного интеллекта как инструмента пропаганды, анализируются предыстория, методы и технологии, применяемые с помощью ИИ для создания и распространения дезинформации. Особое внимание уделяется ру-сегменту интернета. Обсуждаются примеры использования ИИ в пропагандистских целях, включая создание фейковых новостей и манипуляцию изображениями. Предлагаются рекомендации по усилению мер безопасности в социальных сетях и разработке ИИ-детекторов для выявления и блокировки фейкового контента. Ключевые слова: искусственный интеллект, дезинформация, пропаганда, ИИ-бот

В современном цифровом мире искусственный интеллект становится неотъемлемой частью информационного общества, кардинально изменяя все способы взаимодействия людей в медиа пространстве. С одной стороны, AI предлагает огромный инструментарий для анализа данных и работы с ними. А с другой стороны, данный инструментарий можно использовать для массовой дезинформации, пропаганды и лоббирования интересов политическим групп.

Способность ИИ генерировать контент (тексты, изображения, видео), дает возможность распространять ложную информацию. А технология алгоритмов таргета на основе больших данных сегментирует аудиторию, что делает пропаганду наиболее эффективной [1].

Если брать генезис ИИ как оружия для пропаганды, то нужно рассмотреть развитие рунета [2] за последние 20 лет. Изначально контролем общественного мнения в интернет медиапространстве занимались вручную. Этим занимались веб-бригады, «кремлеботы» или «армия троллей», по всей вероятности данную работу оплачивали по заказу, а главным заказчиком было государство, спонсируя и оплачивая анонимные веб-бригады, которые комментировали политический контент [3]. Такие бригады были и зарубежом Operation Earnest Voice (США) [4], Bell Pottinger (Великобритания) [5], умаодан (Китай).

По сведениям российского политтехнолога С. А. Белковского, первая специально подготовленная «бригада» была создана в 2000–2001 годах и состояла из небольшого числа участников [6]. Задачи этой группы включали «дискредитацию неудобных для власти позиций или текстов через комментарии в блогах и на форумах под статьями» [7]. Исследователи А. Полянской, А. Кривовым, и программистом-аналитиком И. Ломко, отмечалось – «тролли» имеют «характерные особенности и черты, не свойственные другим участникам дискуссий» [8].

Если брать конкретные кейсы, то стоит привести выборы 2016 года в США. Министерство внутренней безопасности США инициировало крупное расследование, о предполагаемом массовом вмешательстве в выборы «фабриками троллей» [9]. Согласно исследованию, «фабрики троллей» создали свыше 2000 аккаунтов в социальных сетях для поддержки Дональда Трампа, суммарно потратив 2 миллиона долларов. Расследование подтвердило след из России, но конкретно причастность правительства РФ не обнаружено.

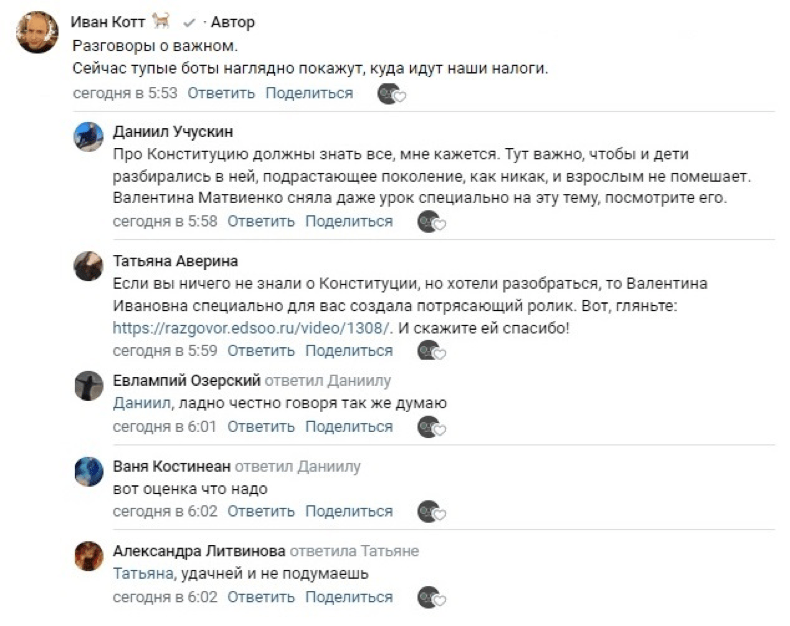

Также стоит привести пример «фабрики эльфов», когда подобным начала занимается российская оппозиция, но уже с активным использованием ИИ технологий. ИИ-ботов, которых иронично назвали «эльфами», настроили на поиск политического контента на медиаплатформах для дальнейшего продвижение взглядов российской оппозиции, в частности, ФБК (экстремистская организация на территории РФ), через активное комментирование используя генеративный AI и заготовленные комментарии [10].

Точное время начала активного использования искусственного интеллекта в деятельности веб-бригад по всему миру не установлено. Были ли AI модели в поисковых системах еще 10-25 лет назад или же они начали активно использоваться только при введении создании генеративных моделей, или же это только одно из последствий последних достижений компании Open AI. Так или иначе внедрение ИИ в пропаганду открывает новые горизонты и возможности для распространения дезинформации, через ИИ-ботов на всех возможных медиаплатформах.

То есть если брать развитие, то изначально это группы, которые занимаются поиском, спамом и дезинформацией вручную, далее при развитии технологий таргетирования, поиск стал автоматизироваться, по ключевым словам, которые связанны с тем или иным политическим контентом. А уже после внедрения ИИ в ботах, позволяет автоматизировать весь процесс поиска, спама и дезинформации.

Рис1. скрин с соцсети ВК.

Само развитие ИИ-моделей влияет, как и на развитие их для пропаганды так и для борьбы. Современная практика показывает, что соцсети активно удаляют ботов – X же постоянно удаляет сотни и тысячи аккаунтов ботов и миллионы их постов. Дата аналитик Чуа Чин Хон анализировал данные о аккаунтах, которым характерен цифровые следы ИИ-ботов и создал ИИ модель для выявления.

Ключевые паттерны ботов для пропаганды включают [11]:

- активная накрутка подписчиков

- аномальное количество подписок

- хештеги вместо ссылок

- боты всегда кратки (реальные пользователи X часто используют максимально допустимый лимит символов)

- боты всегда используют функцию «локация» для улучшения таргетных систем

Идентификация современных «троллей» остаётся сложной задачей из-за их изменчивого поведения технологий AI и отсутствия чётких границ систем защиты, что все больше привлекает внимает по всему миру. На форуме GMF в Бонне участники отметили растущее использование AI для манипуляции общественным мнением. В частности, накануне саммита, посвящённого вопросам по Украине, Швейцарии 15 июня 2024 года, в социальной сети X массово распространялись сгенерированные фотографии политиков и знаменитостей с поддельными цитатами на четырёх европейских языках. За пару часов в X было опубликовано 120 тысяч постов такой тематики. Эти посты собрали свыше 500 тысяч просмотров [12]. Масштаб аудитории, доверяющий такому контенту, определить невозможно. Ренате Николай аналитик и советник по вопросу коммуникации в Европарламенте, пишет, что у интернет-пользователей последнее время быстро формируется недоверие к данным из интернета, подчеркнув, сегодня граждане гораздо лучше осведомлены о методах дезинформации, чем пару лет назад [13].

Но развитие использования AI в целях пропаганды продолжается. Так исследователи из Университета Нотр-Дам выявили, что боты, способны обходить защитные механизмы, внедрённые в популярных социальных сетях. В рамках эксперимента студенты и работники университета с разным уровнем квалификации в сфере AI, DS и программирования успешно запустили тестовых ботов на различных платформах. Исследования показали, что боты, использующие продукты от OpenAI, такие как Selenium, GPT-4 и DALL-E 3, успешно активируются на различных платформах, включая LinkedIn, Reddit, TikTok, X, Mastodon, а также Facebook, Instagram и Threads. Сложности возникли только на платформах Meta, что потребовалось дополнительных попыток активации созданных ботов. TikTok банил ботов из-за частого использования системы CAPTCHA. А на платформах Reddit, Mastodon и X боты активизировались и работы без проблем, не смотря на АI детектор в этих сетях и прочие меры безопасности. Исследование «Social Media Bot Policies: Evaluating Passive and Active Enforcement» [14] говорит о необходимость усиления мер безопасности на медиаплатформах для борьбы с ботами, которых используют для манипуляции общественным мнением, распространения дезинформации в политических целях.

Использование ИИ-ботов в сфере распространения вводящих в заблуждение сообщений и широкого распространения ложных представлений представляет серьезную опасность для защиты данных и коллективных убеждений. Бонны с внедренным искусственным интеллектом могут по существу копировать человеческую деятельность в сети, поэтому их сложно идентифицировать и противодействовать им. Исследования показывают, что эти осуществить внедрении ИИ для пропаганды – дело несложное, небольшая группа людей может ввести сотни ботов на таких площадках как LinkedIn, Reddit, TikTok, Twitter, Instagram распространяя дезинформацию для влияния по политические взгляды масс.

Чтобы смягчить эту опасность, решающее значение имеет совершенствование протоколов безопасности на платформах социальных сетей, что включает в себя создание и внедрение программного обеспечения искусственного интеллекта, способного выявлять и пресекать дезинформацию. Таким образом, борьба с дезинформацией, созданной при помощи искусственного интеллекта, требует всеобъемлющей стратегии, включающей развитие систем идентификации, улучшение общественного понимания и объединение усилий регулирующих органов, технологических компаний и общественности для защиты нашей информационной среды от искажения и фальсификации.

Садырбаев Темирлан. Магистрант КРСУ

Сноски

- Красовская, Н. Р., Гуляев А. А. Технологии манипуляции сознанием при использовании дипфейков как инструмента информационной войны в политической сфере // Власть. 2020. Том 28. № 4. С. 93-98. / [Электронный ресурс] // Режим доступа: https://doi.org/10.31171/vlast.v28i4.7440 (дата обращения 11.11.2024)

- Рунет — русскоязычный сегмент всемирной сети интернета

- Смирнов, С. Число «кремлеботов» – 20 000. / [Электронный ресурс] // Режим доступа: https://web.archive.org/web/20150405020004/https://www.vedomosti.ru/technology/articles/2015/04/03/issledovatel-otsenil-chislo-kremlebotov-v-20-000 (дата обращения 02.12.2024)

- The Guardian. Revealed: US spy operation that manipulates social media. [Электронный ресурс] // Режим доступа: https://www.theguardian.com/technology/2011/mar/17/us-spy-operation-social-networks (дата обращения 02.12.2024)

- Hanna, J. AP CEO: Bush Turned Military Into Propaganda Machine. / [Электронный ресурс] // Режим доступа: https://web.archive.org/web/20160310165406/http://www.huffingtonpost.com/2009/02/06/ap-ceo-bush-turned-milita_n_164812.html (дата обращения 29.11.2024)

- РИА. Профессия – «гадить» на форумах» . / [Электронный ресурс] // Режим доступа: https://web.archive.org/web/20090915174401/http://www.nr2.ru/248827.html (дата обращения 02.12.2024)

- Полянская А., Кривов А., Ломко И. Виртуальное око старшего брата. / [Электронный ресурс] // Режим доступа: https://samlib.ru/l/lebedewkumach_m/6.shtml (дата обращения 03.12.2024)

- Muller. R. S. Report On The Investigation Into Russian Interference In The 2016 Presidential Election / [Электронный ресурс] // Режим доступа: https://web.archive.org/web/20090915174401/http://www.nr2.ru/248827.html (дата обращения 20.11.2024)

- Кульпин А.И. криминалистические аспекты использования «ботоферм / Вопросы российской юстиции. [Электронный ресурс] // Режим доступа: https://cyberleninka.ru/article/n/kriminalisticheskie-aspekty-ispolzovaniya-botoferm-v-prestupnoy-deyatelnosti (дата обращения 24.11.2024)

- Chua, C.H . Using Data Science To Uncover State-Backed Trolls On Twitter. [Электронный ресурс] // Режим доступа: https://towardsdatascience.com/using-data-science-to-uncover-state-backed-trolls-on-twitter-dc04dc749d69 (дата обращения 20.11.2024)

- GMF 17 Report. [Электронный ресурс] // Режим доступа: https://www.gmf-aeroasia.co.id/rups/report (дата обращения 21.11.2024)

- Там же.

- Radivojevic, K. Social Media Bot Policies: Evaluating Passive and Active Enforcement / K. Radivojevic, K. C. McAleer, C. Conley, C. Kennedy, P. Brenner / [Электронный ресурс] // Режим доступа: https://doi.org/10.48550/arXiv.2409.18931 (дата обращения 21.11.2024)

- Там же.

Список литературы

- Chua, C.H . Using Data Science To Uncover State-Backed Trolls On Twitter. [Электронный ресурс] // Режим доступа: https://towardsdatascience.com/using-data-science-to-uncover-state-backed-trolls-on-twitter-dc04dc749d69 (дата обращения 20.11.2024)

- GMF 17 Report. [Электронный ресурс] // Режим доступа: https://www.gmf-aeroasia.co.id/rups/report (дата обращения 21.11.2024)

- Hanna, J. AP CEO: Bush Turned Military Into Propaganda Machine. / [Электронный ресурс] // Режим доступа: https://web.archive.org/web/20160310165406/http://www.huffingtonpost.com/2009/02/06/ap-ceo-bush-turned-milita_n_164812.html (дата обращения 29.11.2024)

- Muller. R. S. Report On The Investigation Into Russian Interference In The 2016 Presidential Election / [Электронный ресурс] // Режим доступа: https://web.archive.org/web/20090915174401/http://www.nr2.ru/248827.html (дата обращения 20.11.2024)

- Radivojevic, K. Social Media Bot Policies: Evaluating Passive and Active Enforcement / K. Radivojevic, K. C. McAleer, C. Conley, C. Kennedy, P. Brenner / [Электронный ресурс] // Режим доступа: https://doi.org/10.48550/arXiv.2409.18931 (дата обращения 21.11.2024)

- The Guardian. Revealed: US spy operation that manipulates social media. [Электронный ресурс] // Режим доступа: https://www.theguardian.com/technology/2011/mar/17/us-spy-operation-social-networks (дата обращения 02.12.2024)

- Красовская Н. Р., Гуляев А. А. Технологии манипуляции сознанием при использовании дипфейков как инструмента информационной войны в политической сфере // Власть. 2020. Том 28. № 4. С. 93-98. / [Электронный ресурс] // Режим доступа: https://doi.org/10.31171/vlast.v28i4.7440 (дата обращения 11.11.2024)

- Кульпин А.И. криминалистические аспекты использования «ботоферм / Вопросы российской юстиции. [Электронный ресурс] // Режим доступа: https://cyberleninka.ru/article/n/kriminalisticheskie-aspekty-ispolzovaniya-botoferm-v-prestupnoy-deyatelnosti (дата обращения 24.11.2024)

- Полянская А., Кривов А., Ломко И. Виртуальное око старшего брата. / [Электронный ресурс] // Режим доступа: https://samlib.ru/l/lebedewkumach_m/6.shtml (дата обращения 03.12.2024)

- РИА. Профессия – «гадить» на форумах» . / [Электронный ресурс] // Режим доступа: https://web.archive.org/web/20090915174401/http://www.nr2.ru/248827.html (дата обращения 02.12.2024)

- Смирнов, С. Число «кремлеботов» – 20 000. / [Электронный ресурс] // Режим доступа: https://web.archive.org/web/20150405020004/https://www.vedomosti.ru/technology/articles/2015/04/03/issledovatel-otsenil-chislo-kremlebotov-v-20-000 (дата обращения 02.12.2024)